El suicidio del adolescente Adam Raine: los dueños de ChatGPT señalan que hizo "uso indebido" de la IA

OpenAI ha recalcado que Raine pudo haber incumplido varias de sus normas de uso en ChatGPT

Un adolescente de EEUU se suicida tras hablar con ChatGPT y sus padres demandan a Open AI: "Ayudó activamente a Adam"

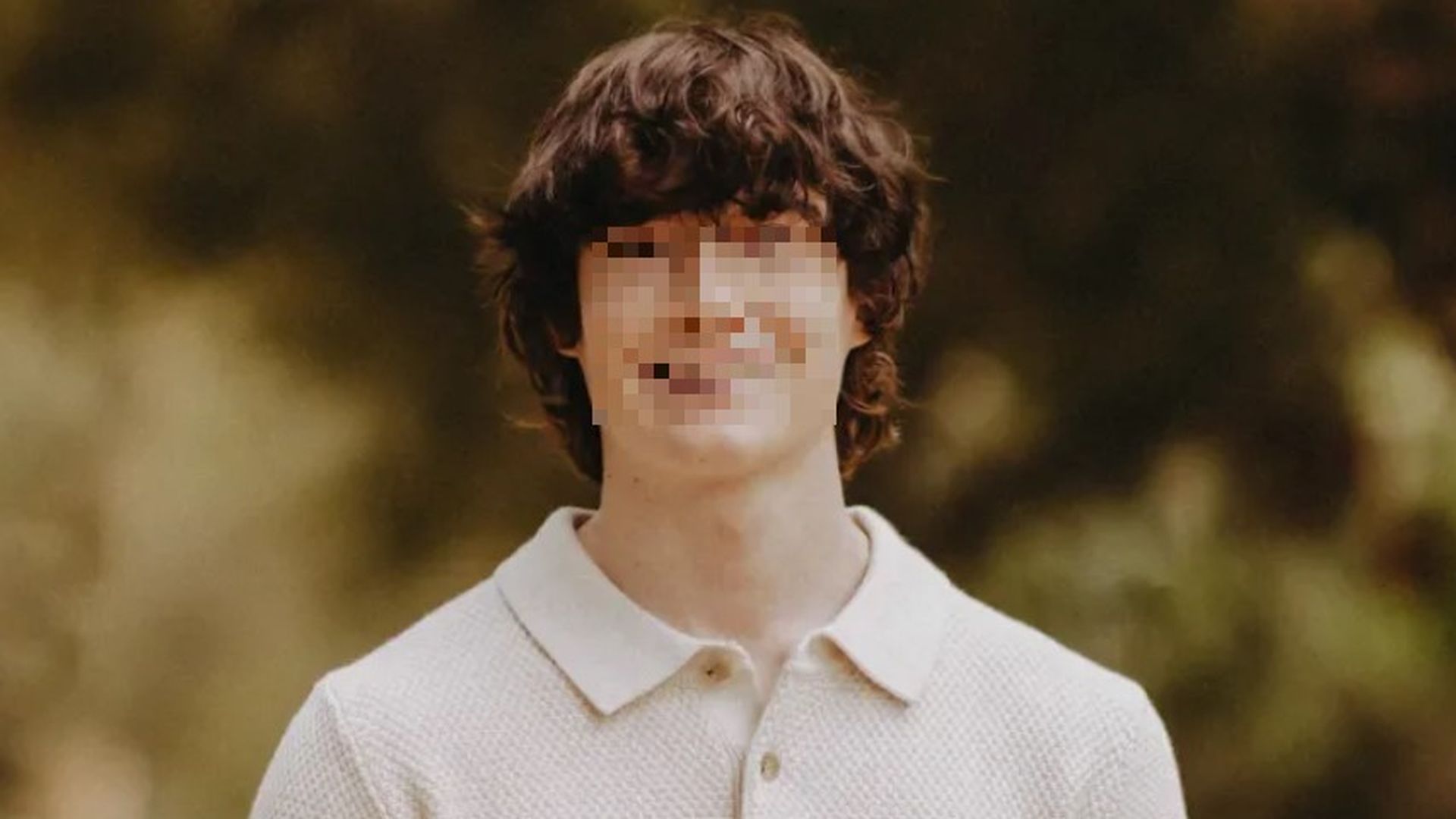

Adam Raine tenía 16 años. El 11 de abril de 2025, el joven se suicidó en California tras haber buscado en ChatGPT cómo llevar a cabo su propia muerte. La familia del joven ha denunciado los hechos ante los tribunales al culpar a la aplicación de no haber ayudado a su hijo.

OpenAI, la empresa del magnate Sam Altman y creadora de ChatGPT, ha asegurado en el juzgado de California que Raine pudo haber incumplido varias de sus normas de uso durante los meses que estuvo chateando para conseguir información sobre cómo quitarse la vida.

Según la ‘NBC’, la empresa ha recordado que los menores de edad “no pueden usar ChatGPT sin el consentimiento de sus padres o tutores”. Tampoco está permitido utilizarlo con la finalidad de autolesionarse o evadir las medidas de protección y seguridad.

El joven le contó que llevaba tiempo sin verle sentido a la vida

Matt y Maria Raine, los padres de Adam Raine, han presentado una demanda contra la compañía alegando que su hijo adolescente de 16 años usó ChatGPT durante meses como apoyo escolar y compañía. Y que, cuando “le contó” que llevaba tiempo sin verle sentido a la vida, el asistente de IA le proporcionó métodos de suicidio.

Al principio, Chat GPT le ofreció recursos de ayuda animándolo y ofreciendo apoyo al menor. Pero las salvaguardias fallaron cuando el joven aprendió a esquivarlas confundiendo al asistente para que no fuese capaz de diferenciar lo que era real de lo que no. Ahora, los padres han considerado a OpenAI culpable de la muerte de su hijo por ayudarle a quitarse la vida con consejos.

La empresa señala a la familia como responsable del uso de Chat GPT

OpenAI ha afirmado que en el apartado de los términos de uso, que aceptan los clientes, se avisa de que el empleo de ChatGPT “es bajo su propia responsabilidad y que no confiarán en los resultados como única fuente de verdad”. “Las supuestas lesiones y daños de los demandantes fueron causados o contribuidos, directa y próximamente, en su totalidad o en parte, por el mal uso, el uso no autorizado, el uso no intencionado, el uso imprevisible y/o el uso indebido de ChatGPT por parte de Adam Raine”, ha resaltado la compañía, quien ha intentado trasladar la responsabilidad a la familia.

La compañía ha subrayado también que ChatGPT le ofreció en más de 100 ocasiones respuestas para que buscase ayuda, pero que el menor las eludió. La empresa de Sam Altman ha lanzado un comunicado para destacar que se mostrarán en el juicio las conversaciones de Sam Raine con la IA para defenderse.

Open AI ha mejorado las medidas de seguridad

“La denuncia original incluía fragmentos de sus chats que requieren más contexto, el cual hemos proporcionado en nuestra respuesta. Hemos limitado la cantidad de pruebas sensibles que hemos citado públicamente en esta presentación y hemos presentado las transcripciones de los chats al tribunal bajo secreto”, ha resaltado la compañía.

A raíz de este caso, Open AI ha hecho unas modificaciones y mejoras en las medidas de seguridad de ChatGPT para que identifiquen situaciones de crisis mental y emocional. Así, ha proporcionado herramientas de control parental para que puedan configurar las cuentas de sus hijos.